Αυτός ο οδηγός θα απεικονίσει τη διαδικασία χρήσης μιας περίληψης συνομιλίας στο LangChain.

Πώς να χρησιμοποιήσετε τη σύνοψη συνομιλίας στο LangChain;

Το LangChain παρέχει βιβλιοθήκες όπως η ConversationSummaryMemory που μπορούν να εξαγάγουν την πλήρη περίληψη της συνομιλίας ή της συνομιλίας. Μπορεί να χρησιμοποιηθεί για να λάβετε τις κύριες πληροφορίες της συνομιλίας χωρίς να χρειάζεται να διαβάσετε όλα τα μηνύματα και το κείμενο που είναι διαθέσιμα στη συνομιλία.

Για να μάθετε τη διαδικασία χρήσης της περίληψης συνομιλίας στο LangChain, απλώς προχωρήστε στα παρακάτω βήματα:

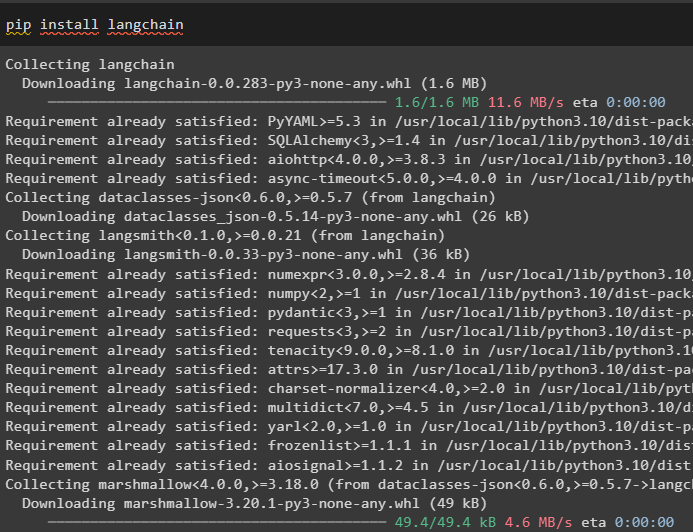

Βήμα 1: Εγκατάσταση μονάδων

Αρχικά, εγκαταστήστε το πλαίσιο LangChain για να λάβετε τις εξαρτήσεις ή τις βιβλιοθήκες του χρησιμοποιώντας τον ακόλουθο κώδικα:

pip install langchain

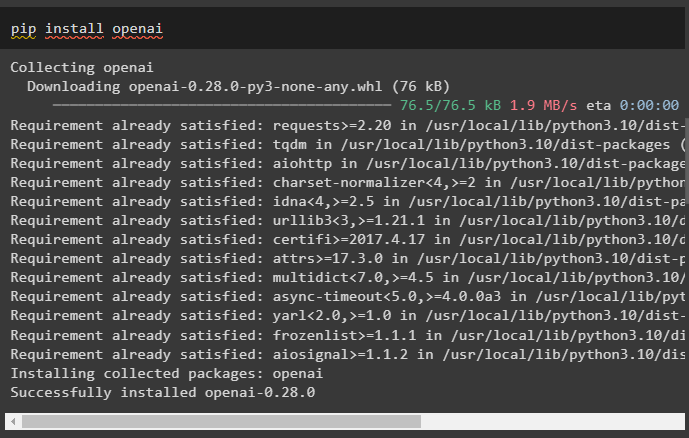

Τώρα, εγκαταστήστε τις μονάδες OpenAI μετά την εγκατάσταση του LangChain χρησιμοποιώντας την εντολή pip:

pip εγκατάσταση openai

Μετά την εγκατάσταση των μονάδων, απλά δημιουργήσει το περιβάλλον χρησιμοποιώντας τον ακόλουθο κώδικα αφού λάβετε το κλειδί API από τον λογαριασμό OpenAI:

εισαγωγή εσείςεισαγωγή getpass

εσείς . κατά προσέγγιση [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'Κλειδί OpenAI API:' )

Βήμα 2: Χρήση περίληψης συνομιλίας

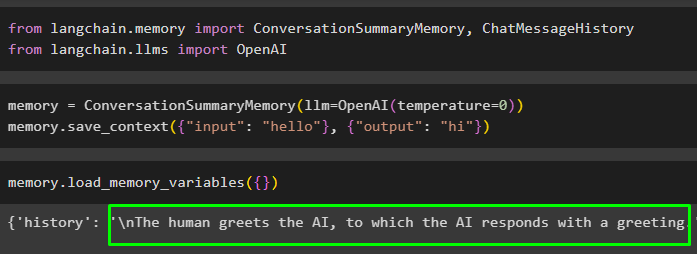

Μπείτε στη διαδικασία χρήσης της σύνοψης συνομιλίας εισάγοντας τις βιβλιοθήκες από το LangChain:

από langchain. μνήμη εισαγωγή ConversationSummaryMemory , Chat Message Historyαπό langchain. llms εισαγωγή OpenAI

Διαμορφώστε τη μνήμη του μοντέλου χρησιμοποιώντας τις μεθόδους ConversationSummaryMemory() και OpenAI() και αποθηκεύστε τα δεδομένα σε αυτό:

μνήμη = ConversationSummaryMemory ( llm = OpenAI ( θερμοκρασία = 0 ) )μνήμη. save_context ( { 'εισαγωγή' : 'Γειά σου' } , { 'παραγωγή' : 'γεια' } )

Εκτελέστε τη μνήμη καλώντας το load_memory_variables() μέθοδος εξαγωγής δεδομένων από τη μνήμη:

μνήμη. load_memory_variables ( { } )

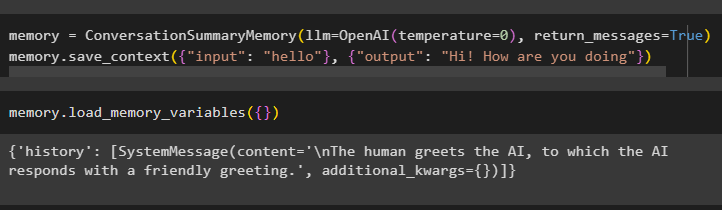

Ο χρήστης μπορεί επίσης να λάβει τα δεδομένα σε μορφή συνομιλίας όπως κάθε οντότητα με ένα ξεχωριστό μήνυμα:

μνήμη = ConversationSummaryMemory ( llm = OpenAI ( θερμοκρασία = 0 ) , επιστροφή_μηνυμάτων = Αληθής )μνήμη. save_context ( { 'εισαγωγή' : 'Γειά σου' } , { 'παραγωγή' : 'Γεια τι κάνεις' } )

Για να λάβετε ξεχωριστά το μήνυμα της τεχνητής νοημοσύνης και των ανθρώπων, εκτελέστε τη μέθοδο load_memory_variables():

μνήμη. load_memory_variables ( { } )

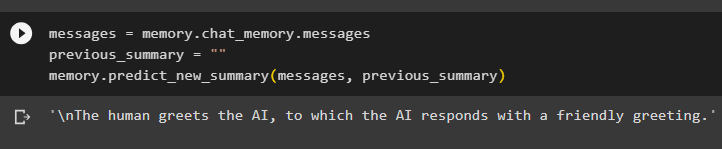

Αποθηκεύστε τη σύνοψη της συνομιλίας στη μνήμη και, στη συνέχεια, εκτελέστε τη μνήμη για να εμφανιστεί η σύνοψη της συνομιλίας/συνομιλίας στην οθόνη:

μηνύματα = μνήμη. chat_memory . μηνύματαπροηγούμενη_σύνοψη = ''

μνήμη. predict_new_summary ( μηνύματα , προηγούμενη_σύνοψη )

Βήμα 3: Χρήση περίληψης συνομιλίας με υπάρχοντα μηνύματα

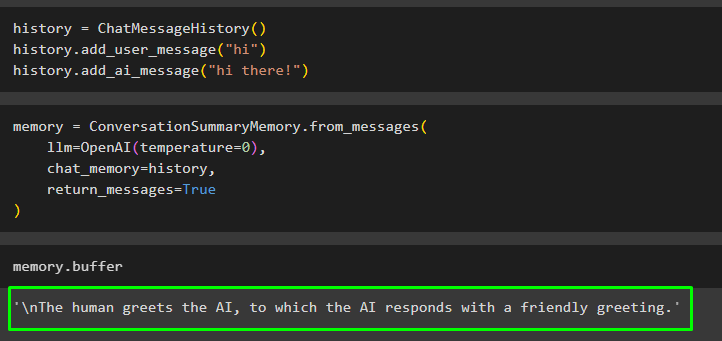

Ο χρήστης μπορεί επίσης να λάβει τη σύνοψη της συνομιλίας που υπάρχει έξω από την τάξη ή τη συνομιλία χρησιμοποιώντας το μήνυμα ChatMessageHistory(). Αυτά τα μηνύματα μπορούν να προστεθούν στη μνήμη, ώστε να μπορεί να δημιουργήσει αυτόματα τη σύνοψη της πλήρους συνομιλίας:

ιστορία = Chat Message History ( )ιστορία. add_user_message ( 'γεια' )

ιστορία. add_ai_message ( 'Γεια σου!' )

Δημιουργήστε το μοντέλο όπως το LLM χρησιμοποιώντας τη μέθοδο OpenAI() για να εκτελέσετε τα υπάρχοντα μηνύματα στο chat_memory μεταβλητός:

μνήμη = ConversationSummaryMemory. from_messages (llm = OpenAI ( θερμοκρασία = 0 ) ,

chat_memory = ιστορία ,

επιστροφή_μηνυμάτων = Αληθής

)

Εκτελέστε τη μνήμη χρησιμοποιώντας το buffer για να λάβετε τη σύνοψη των υπαρχόντων μηνυμάτων:

μνήμη. ρυθμιστής

Εκτελέστε τον ακόλουθο κώδικα για να δημιουργήσετε το LLM διαμορφώνοντας την προσωρινή μνήμη χρησιμοποιώντας τα μηνύματα συνομιλίας:

μνήμη = ConversationSummaryMemory (llm = OpenAI ( θερμοκρασία = 0 ) ,

ρυθμιστής = '''Ο άνθρωπος ρωτά τη μηχανή ερωτήσεων για τον εαυτό του

Το σύστημα απαντά ότι η τεχνητή νοημοσύνη είναι φτιαγμένη για τα καλά καθώς μπορεί να βοηθήσει τους ανθρώπους να επιτύχουν τις δυνατότητές τους''' ,

chat_memory = ιστορία ,

επιστροφή_μηνυμάτων = Αληθής

)

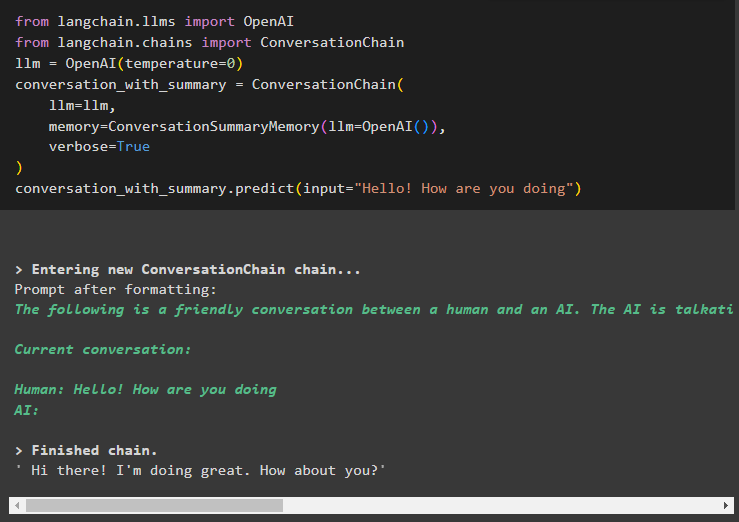

Βήμα 4: Χρήση της σύνοψης συνομιλίας στην αλυσίδα

Το επόμενο βήμα εξηγεί τη διαδικασία χρήσης της περίληψης συνομιλίας σε μια αλυσίδα χρησιμοποιώντας το LLM:

από langchain. llms εισαγωγή OpenAIαπό langchain. αλυσίδες εισαγωγή Αλυσίδα συνομιλίας

llm = OpenAI ( θερμοκρασία = 0 )

συνομιλία_με_σύνοψη = Αλυσίδα συνομιλίας (

llm = llm ,

μνήμη = ConversationSummaryMemory ( llm = OpenAI ( ) ) ,

πολύλογος = Αληθής

)

συνομιλία_με_σύνοψη. προλέγω ( εισαγωγή = 'Γεια σου. Τι κάνεις' )

Εδώ αρχίσαμε να χτίζουμε αλυσίδες ξεκινώντας τη συζήτηση με μια ευγενική έρευνα:

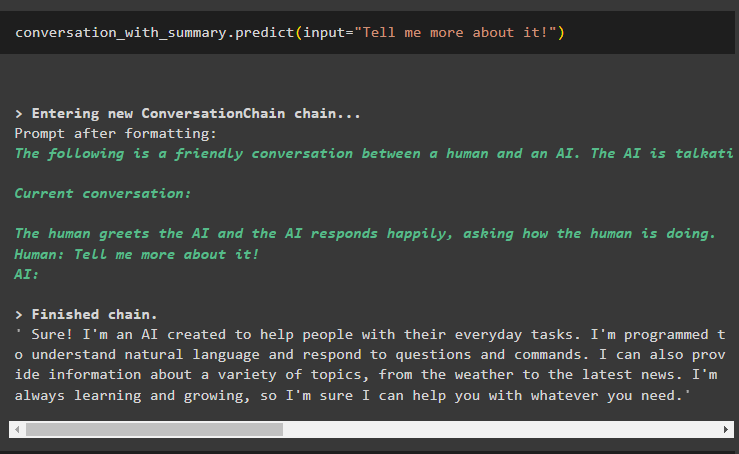

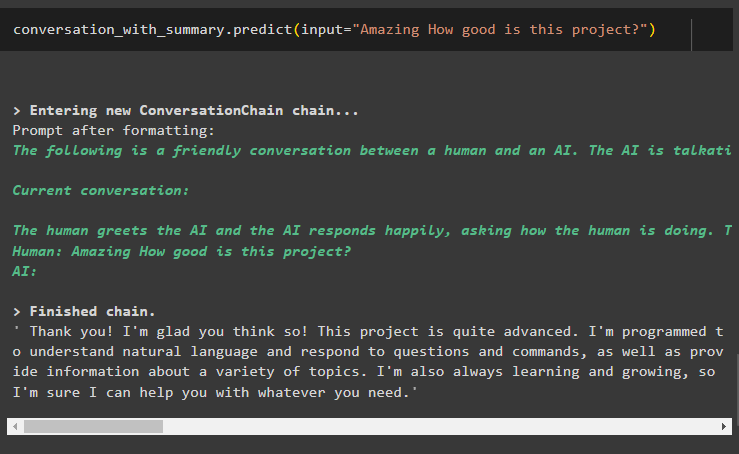

Τώρα μπείτε στη συζήτηση ρωτώντας λίγο περισσότερα για το τελευταίο αποτέλεσμα για να το επεκτείνετε:

συνομιλία_με_σύνοψη. προλέγω ( εισαγωγή = 'Πες μου κι άλλα γι 'αυτό!' )Το μοντέλο εξήγησε το τελευταίο μήνυμα με μια λεπτομερή εισαγωγή στην τεχνολογία AI ή στο chatbot:

Εξάγετε ένα σημείο ενδιαφέροντος από την προηγούμενη έξοδο για να οδηγήσετε τη συνομιλία σε μια συγκεκριμένη κατεύθυνση:

συνομιλία_με_σύνοψη. προλέγω ( εισαγωγή = 'Καταπληκτικό Πόσο καλό είναι αυτό το έργο;' )Εδώ λαμβάνουμε λεπτομερείς απαντήσεις από το bot χρησιμοποιώντας τη βιβλιοθήκη μνήμης σύνοψης συνομιλιών:

Αυτό αφορά τη χρήση της περίληψης συνομιλίας στο LangChain.

συμπέρασμα

Για να χρησιμοποιήσετε το μήνυμα περίληψης συνομιλίας στο LangChain, απλώς εγκαταστήστε τις λειτουργικές μονάδες και τα πλαίσια που απαιτούνται για τη ρύθμιση του περιβάλλοντος. Μόλις ρυθμιστεί το περιβάλλον, εισαγάγετε το ConversationSummaryMemory βιβλιοθήκη για τη δημιουργία LLM χρησιμοποιώντας τη μέθοδο OpenAI(). Μετά από αυτό, απλώς χρησιμοποιήστε τη σύνοψη συνομιλίας για να εξαγάγετε τη λεπτομερή έξοδο από τα μοντέλα που είναι η περίληψη της προηγούμενης συνομιλίας. Αυτός ο οδηγός έχει επεξεργαστεί τη διαδικασία χρήσης της μνήμης σύνοψης συνομιλιών χρησιμοποιώντας τη μονάδα LangChain.