Σε αυτήν την εποχή, τα Transformers είναι τα πιο ισχυρά μοντέλα που έχουν προσφέρει τα καλύτερα αποτελέσματα σε πολλαπλές λειτουργίες NLP (Natural Language Processing). Αρχικά, χρησιμοποιήθηκε για εργασίες μοντελοποίησης γλώσσας, συμπεριλαμβανομένης της δημιουργίας κειμένου καθώς και της ταξινόμησης, της αυτόματης μετάφρασης και πολλά άλλα. Αλλά τώρα, χρησιμοποιείται επίσης για αναγνώριση αντικειμένων, ταξινόμηση εικόνων και πολλές άλλες εργασίες όρασης υπολογιστή.

Σε αυτό το σεμινάριο, θα παρέχουμε τη διαδικασία για την εκτέλεση της ταξινόμησης κειμένου χρησιμοποιώντας Transformers.

Πώς να εκτελέσετε ταξινόμηση κειμένου χρησιμοποιώντας μετασχηματιστές;

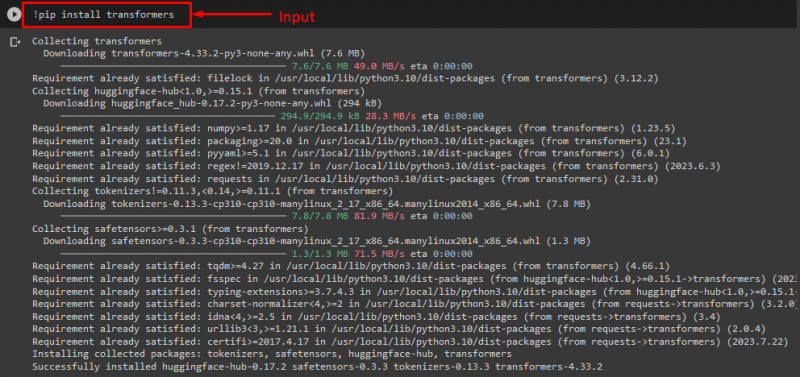

Για να εκτελέσετε την ταξινόμηση κειμένου χρησιμοποιώντας Transformers, πρώτα απ 'όλα, εγκαταστήστε το ' μετασχηματιστές ” βιβλιοθήκη εκτελώντας την παρεχόμενη εντολή:

! κουκούτσι εγκαθιστώ μετασχηματιστές

Όπως μπορείτε να δείτε, η καθορισμένη βιβλιοθήκη έχει εγκατασταθεί με επιτυχία:

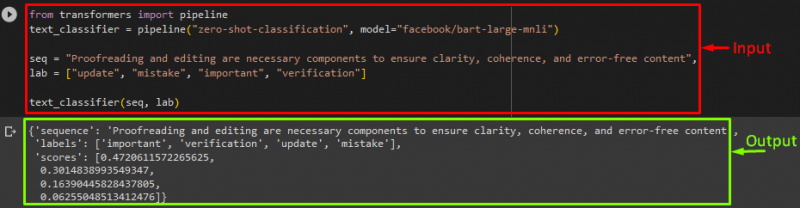

Στη συνέχεια, εισαγάγετε το ' αγωγός ' από το ' μετασχηματιστές ' βιβλιοθήκη:

από αγωγό εισαγωγής μετασχηματιστών

Εδώ, το « αγωγός ” θα περιλαμβάνει την εργασία NLP που πρέπει να εκτελέσουμε και το επιθυμητό μοντέλο μετασχηματιστή για αυτήν τη λειτουργία μαζί με το tokenizer.

Σημείωση: Το tokenizer χρησιμοποιείται για την εκτέλεση επεξεργασίας του κειμένου για να παρέχεται η είσοδος του μοντέλου διαχωρίζοντας το κείμενο σε διακριτικά.

Μετά από αυτό, χρησιμοποιήστε το ' αγωγός() ' λειτουργία και περάστε το ' μηδενική βολή-ταξινόμηση ” ως επιχείρημα. Στη συνέχεια, περάστε μια άλλη παράμετρο που είναι το μοντέλο μας. Χρησιμοποιούμε το Facebook ' ΜΠΑΡΤ ” μοντέλο μετασχηματιστή. Εδώ, δεν χρησιμοποιούμε το tokenizer επειδή μπορεί να συναχθεί αυτόματα από το καθορισμένο μοντέλο:

text_classifier = αγωγός ( 'μηδενική βολή-ταξινόμηση' , μοντέλο = 'facebook/bart-large-mnli' )

Τώρα, δηλώστε το ' επ ” μεταβλητή που περιέχει το κείμενο εισόδου μας το οποίο πρέπει να ταξινομηθεί. Στη συνέχεια, παρέχουμε τις κατηγορίες στις οποίες θέλουμε να ταξινομήσουμε το κείμενο και να αποθηκεύσουμε στο ' εργαστήριο ” που είναι γνωστό ως ετικέτες:

εργαστήριο = [ 'εκσυγχρονίζω' , 'λάθος' , 'σπουδαίος' , 'επαλήθευση' ]

Τέλος, εκτελέστε τη διοχέτευση μαζί με την είσοδο:

Μετά την εκτέλεση του αγωγού, όπως μπορείτε να δείτε το μοντέλο προέβλεψε την ακολουθία που παρέχουμε να ταξινομηθεί:

Επιπλέον πληροφορίες: Εάν θέλετε να επιταχύνετε την απόδοση του μοντέλου, πρέπει να χρησιμοποιήσετε τη GPU. Εάν ναι, τότε, για αυτόν τον σκοπό, μπορείτε να καθορίσετε ένα όρισμα συσκευής στο pipeline και να το ορίσετε σε ' 0 ' για να χρησιμοποιήσετε τη GPU.

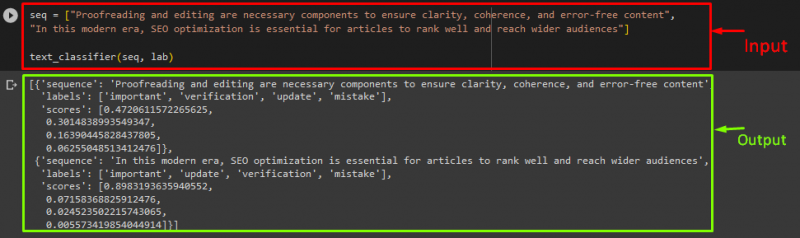

Εάν θέλετε να ταξινομήσετε το κείμενο σε περισσότερες από μία εντολές κειμένου ακολουθίας/εισόδου, τότε μπορείτε να τις προσθέσετε σε μια λίστα και να το μεταφέρετε ως είσοδο στις σωληνώσεις. Για το σκοπό αυτό, ελέγξτε το απόσπασμα κώδικα:

επ = [ 'Η διόρθωση και η επεξεργασία είναι απαραίτητα στοιχεία για τη διασφάλιση της σαφήνειας, της συνοχής και του περιεχομένου χωρίς σφάλματα' ,'Σε αυτή τη σύγχρονη εποχή, η βελτιστοποίηση SEO είναι απαραίτητη για να κατατάσσονται καλά τα άρθρα και να προσεγγίζουν ευρύτερο κοινό' ]

text_classifier ( επ , εργαστήριο )

Παραγωγή

Αυτό είναι! Συγκεντρώσαμε τον ευκολότερο τρόπο για την εκτέλεση της ταξινόμησης κειμένου χρησιμοποιώντας Transformers.

συμπέρασμα

Οι μετασχηματιστές χρησιμοποιούνται για την εκτέλεση εργασιών μοντελοποίησης γλώσσας, όπως δημιουργία κειμένου, ταξινόμηση κειμένου και μηχανική μετάφραση, καθώς και εργασίες όρασης υπολογιστή, συμπεριλαμβανομένης της αναγνώρισης αντικειμένων και της ταξινόμησης εικόνων. Σε αυτό το σεμινάριο, παρουσιάσαμε τη διαδικασία για την εκτέλεση ταξινόμησης κειμένου χρησιμοποιώντας μετασχηματιστές.